작년 11월에 최초 공개된 ChatGPT는 기대를 뛰어넘는 성능을 보여주며 현재 전세계 1억명이 넘는 사용자를 확보하였습니다. 거대 언어 모델이 제시한 잠재력과 가능성은 사용자들을 매료시키기에 충분했고, 이는 카페인 없이는 오전에 눈을 뜨기도 힘든 직장인들 조차 ChatGPT를 보다 똑똑하게 활용하는 방법을 고민하고 공부하게 만들었습니다. 이미 많은 유튜브와 블로그에서 저마다의 활용법을 소개하고 있고, 실제 현장에서도 영어 이메일 번역에서 부터 개발 코드 리펙토링까지 다양한 방식으로 똘똘한 AI를 활용하고 있는데요, 이를 바라보는 회사들의 입장은 장려와 규제, 두가지 방향으로 나뉘고 있습니다.

먼저 챗봇을 통한 업무 효율성 향상에 초점을 맞추는 경우 AI 활용법에 대한 강연과 교육을 제공할 뿐만 아니라 직원들 간 서로의 지식과 경험을 공유할 수 있는 플랫폼을 만들어 직원들의 AI역량 개발을 장려합니다. 하지만 회사 내부 정보를 외부로 유출하게 되는 보안문제, AI로 작성된 부정확한 정보가 검수 없이 업무에 활용될 수 있다는 신뢰성 문제 등으로 인해 ChatGPT 사용을 신중하게 검토해야 한다는 목소리 또한 존재하며 이러한 관점의 차이는 업종별, 기업별로 뿐만 아니라 같은 기업, 같은 조직 내에서도 다양하게 나타나고 있습니다.

이에 대해 블룸버그에서 소개한 2023년 가트너 서베이 결과에 따르면 서베이 대상인 HR리더 중 절반이 ChatGPT 사용 가이드를 검토하고 있다고 답했다고 하는데요, 그와 동시에 1/3에 해당하는 응답자들은 여러가지 우려에도 불구하고 ChatGPT 사용 규제를 검토하고 있지 않다고 답한 것으로 알려졌습니다. 월가의 실제 사례들을 살펴보면 뱅크 오브 아메리가, JP모건 체이스, 씨티그룹, 도이체방크, 골드만삭스 그룹과 같은 회사에서는 ChatGPT의 사용을 전면 금지한 반면 켄 그리핀의 헤지펀드 씨타델에서는 ChatGPT의 사용을 장려하며 OpenAI사와 회사 차원의 ChatGPT 라이센스 계약을 추진하기도 하였습니다. 국내에서는 삼성전자가 Prompt형태로 ChatGPT에게 회사 내부정보가 입력되는 사례를 경험한 후 챗봇 사용을 금지하는 가이드를 발표하기도 했는데, 이처럼 AI의 활용에 대한 다양한 관점이 혼재하고 명확한 가이드가 정립되지 않은 상황에서 우리 회사의 특수성을 반영한 가이드를 수립하는 것은 많은 경영지원 담당자의 고민거리일 것입니다.

본 포스트에서는 특정한 관점 및 가이드의 옳고 그름을 판단하기에 앞서 정책 수립 시 참고할 수 있도록 챗봇 사용에 대한 몇가지 오해와 진실을 알아보도록 하겠습니다.

1. ChatGPT는 사용자가 제공하는 정보를 저장/학습 하나요?

사용자가 OpenAI의 언어모델에게 정보를 제공하는 방법은 크게 두가지로 나뉩니다.

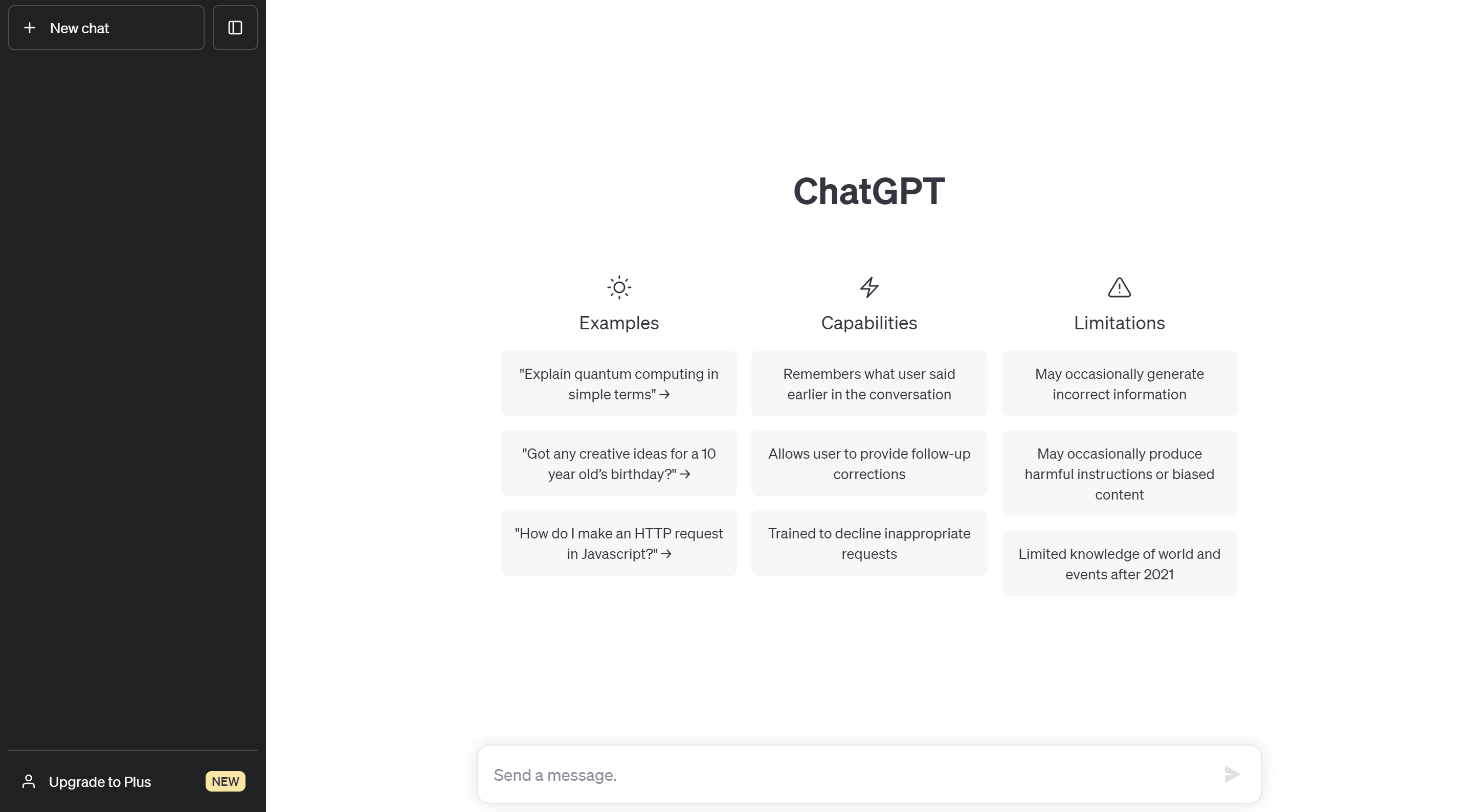

첫번째는 많은분들이 익숙한 non-API서비스를 이용하는 방법인데요, 어려운 용어를 이해하기 쉽게 풀어 설명하자면 ChatGPT 홈페이지에 들어가서 채팅창에 직접 질문하는 방법을 의미합니다.

이러한 non-API서비스를 통해 입력된 사용자 정보는 모두 저장되며 이후 AI모델 학습을 위해 사용될 수 있습니다. 단, Setting → Data Controls → Chat History & Training 메뉴에서 사용자 데이터 저장 및 활용 여부를 설정할 수 있습니다.

두번째는 OpenAI API를 통해 OpenAI에서 제공하는 언어모델을 활용하는 방법인데요, 이 또한 API개념이 생소한 이웃분들을 위해 쉽게 풀어보자면 코드를 작성하여 프로그래밍 언어로 OpenAI의 거대 언어 모델(Large Language Model, LLM)을 활용하는 방법입니다. 본 글의 초반부에서는 ChatGPT와 거대 언어 모델, AI의 개념들을 혼용하여 사용했는데, 보다 정확히 표현하자면 OpenAI에서는 GPT-3, GPT-4등 거대 언어 모델을 개발했고, ChatGPT는 해당 언어모델을 사용해 만든 non-API 서비스의 이름입니다. OpenAI의 API 데이터 사용 정책에 따르면 API를 통해 입력된 사용자 정보는 AI모델 학습을 위해 사용되지 않으며, 오남용 모니터링을 위해 최초 30일간 저장 후 이후에는 삭제된다고 합니다. 그리고 이 또한 별도의 신청을 통해 사용자의 정보를 저장하고 AI모델 학습에 활용하도록 기본 설정을 변경할 수 있습니다.

정리하자면 OpenAI의 사용자 데이터 저장 및 활용 여부는 다음과 같습니다.

- ChatGPT 홈페이지에 접속하여 채팅창에 직접 입력하는 데이터 (non-API)

: 기본적으로 저장/활용되나 설정 메뉴를 통해 저장/활용되지 않도록 변경 가능 - 코드를 작성하여 프로그램 언어를 통해 입력된 데이터 (API)

: 기본적으로 저장/활용되지 않으며 별도의 신청을 통해 저장/활용 되도록 변경 가능

2. ChatGPT에게 제공된 나의 데이터를 다른 "사람"이 볼 수 있나요?

다음 조건을 충족하는 경우 데이터 접근 권한을 가진 OpenAI의 직원 및 OpenAI와 계약관계에 있는 제 3자가 데이터를 직접 확인할 수 있습니다.

- 서비스 오남용 및 보안 문제를 조사하기 위한 경우

- 고객지원 업무를 위해 사용자가 요청한 경우

- 법적 의무를 준수하기 위해 필요한 경우

- 사용자가 제공한 정보를 활용하여 AI모델을 정교화 하기 위한 경우

데이터 사용에 관한 FAQ에서 사용자 데이터에 대한 모든 접근을 모니터링 하고 접근 권한이 부여된 인원에 대해서는 사전 보안 교육 및 프라이버시 교육을 실시한다고도 덧붙이고 있습니다.

3. ChatGPT를 통해 얻은 정보를 상업적으로 이용할 수 있나요?

ChatGPT를 통해 생성된 컨텐츠는 모두 사용자에게 귀속됩니다. OpenAI의 약관을 준수하여 생성된 컨텐츠는 판매, 출판 등 상업적 용도를 포함하여 사용자의 목적에 따라 자유롭게 이용될 수 있습니다. 단, ChatGPT가 타인의 저작물을 승인없이 학습하고 해당 내용이 반영된 컨텐츠를 생성한 경우에는 저작권법상 문제의 소지가 있을 수 있습니다.

4. ChatGPT 서비스를 회사 내에 서버를 두고 자체적으로 운영할 수 있나요?

불가능합니다. 현재는 on-premise hosting을 지원하지 않는다고 합니다.

오늘의 포스트에서는 ChatGPT 활용 기준 수립하기 위해 알아두면 좋을 몇가지 궁금증들을 살펴보았습니다. 하지만 그래서 실무적으로는 ChatGPT 사용을 어떻게 규제해야 돼?라는 질문이 여전히 남는데요, 제 개인적인 의견으로는 사용자 데이터가 기본적으로 저장되고 학습에 활용되는 ChatGPT 서비스(https://chat.openai.com)는 사내망에서 접속을 차단는 것이 안전하다고 생각합니다. 대신 API를 통해 입력되는 데이터는 기본적으로 저장되거나 학습에 활용되지 않기 때문에 OpenAI API를 활용해 사내 직원들을 위한 별도의 채팅 서비스를 개발하여 제공하는 것이 좋겠습니다.

회사 규모가 크지 않아 사내 채팅 시스템을 직접 또는 외주를 통해 개발하기가 힘든 회사들은 ChatGPT 서비스 접속을 허용하되 챗봇 오남용으로 인해 발생할 수 있는 문제 사례들을 적극적으로 교육하여 ChatGPT를 사용하는 직원들이 경각심을 갖도록 하는 방법을 고려해 볼 수 있을 것 같습니다.

오늘 포스트를 통해 다룬 질문 외에도 ChatGPT에 대해 궁금한 점이 있으시면 얼마든지 댓글 남겨주시기를 부탁드리며 글 마치겠습니다.

감사합니다!

'코딩' 카테고리의 다른 글

| OPENDART API를 활용하여 파이썬으로 기업 정보 검색하기 (2) | 2023.08.19 |

|---|---|

| 파이썬 Chat GPT로 인사 평가 의견을 자동 요약하기 (1) | 2023.06.27 |

| 윈도우에서 파이썬으로 아웃룩 이메일 자동화하기 (0) | 2023.06.07 |

| 파이썬으로 PPT 노가다 자동화 하기 (4) | 2023.06.02 |

| 파이썬으로 Chat GPT에게 외부 정보 학습시키기 (3) | 2023.05.25 |